ประสาทความท้าทายในการเล่นกอล์ฟสุทธิก่อนหน้า ( นี้และว่า ) แรงบันดาลใจที่จะก่อให้เกิดความท้าทายใหม่:

ความท้าทาย

ค้นหาเครือข่ายนิวรัล feedforward ที่เล็กที่สุดซึ่งให้เวกเตอร์อินพุต 4 มิติใด ๆกับรายการจำนวนเต็มใน , เครือข่ายเอาต์พุตด้วย ข้อผิดพลาดการประสานงานที่ชาญฉลาดอย่างเคร่งครัดมีขนาดเล็กกว่า0.5

ภัณฑ์

สำหรับความท้าทายนี้เป็นเครือข่ายประสาท feedforwardถูกกำหนดให้เป็นองค์ประกอบของชั้น ชั้นเป็นฟังก์ชันที่ระบุโดยเมทริกซ์ของน้ำหนัก , เวกเตอร์ของอคติและฟังก์ชั่นการเปิดใช้งาน ที่ใช้พิกัด - ฉลาด

เนื่องจากสามารถเปิดใช้งานฟังก์ชั่นการเปิดใช้งานสำหรับงานที่กำหนดเราจำเป็นต้อง จำกัด คลาสของฟังก์ชั่นการเปิดใช้งานเพื่อให้ความท้าทายนี้น่าสนใจ อนุญาตให้ใช้งานฟังก์ชั่นต่อไปนี้:

เอกลักษณ์

Relu

Softplus

แทนเจนต์ซึ่งเกินความจริง

sigmoid

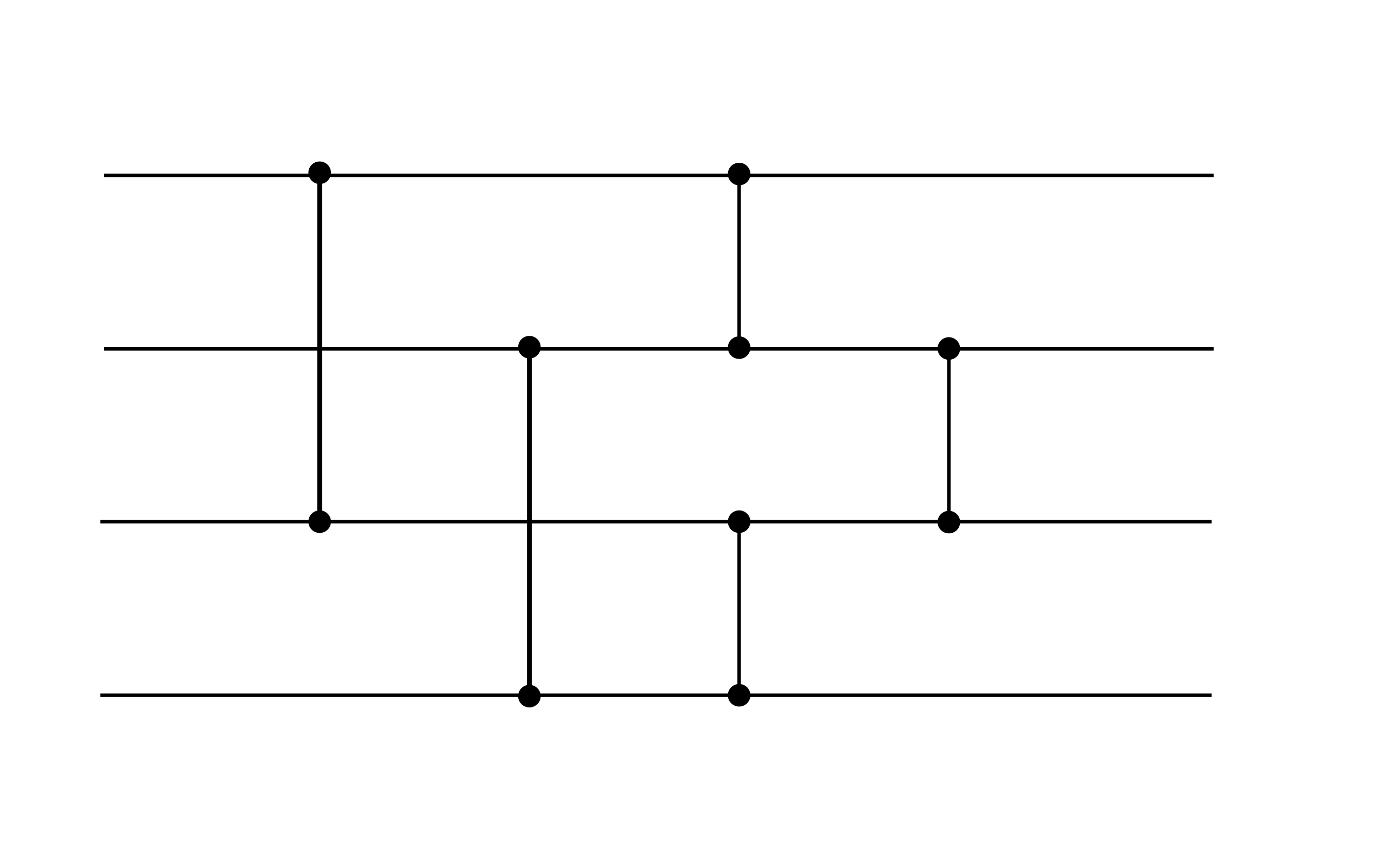

โดยรวมแล้ว, โครงข่ายประสาทที่ยอมรับได้ใช้รูปแบบสำหรับบาง , ซึ่งแต่ละชั้นถูกระบุโดยน้ำหนัก , อคติ , และฟังก์ชั่นการเปิดใช้งานจากรายการด้านบน ตัวอย่างเช่นตาข่ายประสาทต่อไปนี้สามารถใช้ได้ (แม้ว่าจะไม่เป็นไปตามเป้าหมายประสิทธิภาพของการท้าทายนี้ แต่อาจเป็นอุปกรณ์ที่มีประโยชน์):

ตัวอย่างนี้แสดงสองชั้น เลเยอร์ทั้งสองไม่มีศูนย์อคติ เลเยอร์แรกใช้การเปิดใช้งาน ReLU ในขณะที่ชั้นที่สองใช้การเปิดใช้งานข้อมูลเฉพาะตัว

เกณฑ์การให้คะแนน

คะแนนของคุณคือจำนวนรวมของน้ำหนักและอคติที่ไม่ใช่ศูนย์ทั้งหมด

(เช่นตัวอย่างด้านบนมีคะแนน 16 เนื่องจากเวกเตอร์อคติเป็นศูนย์)